The road to build the intelligent Web 3.0 is paved with social networks and contextual real-time communication. Web 3.0 is an advanced social computing approach: computer-mediated real-time communication between people based on a framework of meta-data that allows people as well as computers to conduct context-related and thus knowledge building communication. It is a kind of Post-Google World with people being real-time connected instead of communication via Websites (see for example Alistair Croll’s idea of How Twitter’s ReTweet creates PageRanks for humans). These networked people will create a digitally augmented collective intelligence and new ways of intellectual cooperation to innovate and invent.

Tweets and Updates are important building blocks in this real-time computing scenario. These tools are the cells of a knowledge building system and it’s binding agents. Tweets and Updates connect people as well as people with the collective knowledge base via meta-data. Meta-Data can be grouped into 5 classes:

· personal data (who am I),

· relationship data (my social graph)

· activity data (what, where, when do I say/do something),

· contextual data (information, topic/thread, people) and

· systems data (which tools do I use)

Twitter (like any other social network) and it’s apps are producing lot of meta-data when distributing Tweets. Meta-data is generated in 3 ways:

· User: plain text enriched with context (#, @, http://, RT)

· System: information about space-time information, systems data

· Network: transactional & dissemination data

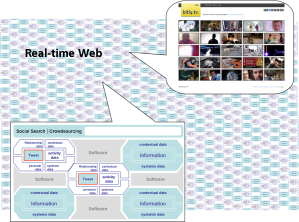

A key position in building a framework for meta-data will be held by URL shorteners. The elevated position of URL shorteners result from two effects. They provide the service to publishers to shorten and track their URLs and act as connection points between information/knowledge and social networks (people). And, in providing this service more transactional meta-data is generated when the Tweet disseminates. URL shorteners like bit.ly store those transactional meta-data along with the other meta-data (received via Twitter API) in their repository. These repositories are to become the Genome of the Web 3.0 as they contain the roadmap for the collective knowledge.

As Twitter is used as distribution system by the information elite (blogosphere) a high percentage of Tweets contain links (Dan Zarrella estimates, that 56% of ReTweets contain Links). These Links in conjunction with the context-related symbols (#, @) build the DNA of the collective intelligence of Web 3.0. bit.ly already began to exploit crowdsourcing for a new business model: bitly.tv. The realtime video channel shows videos that are shared within Web with shortened bit.ly URLs.

The nature of information has changed fundamentally by social networks and we have to adapt our framework for how we obtain and process information. We need something like XML represented for Web 2.0 – a meta-language for people and computers (see the research project Information Economy metaLanguage IELM). This comprises the development of strategies for using social media tools to access real-time data and crowdsource information. To organize the collective intelligence it needs social network (real-time) clients that are able to understand and work with meta-data. The pace of the evolution into Web 3.0 depends heavily on how fast the industry copies with the task of organizing meta-data and/or providing tools for that.